Análisis de correlación lineal

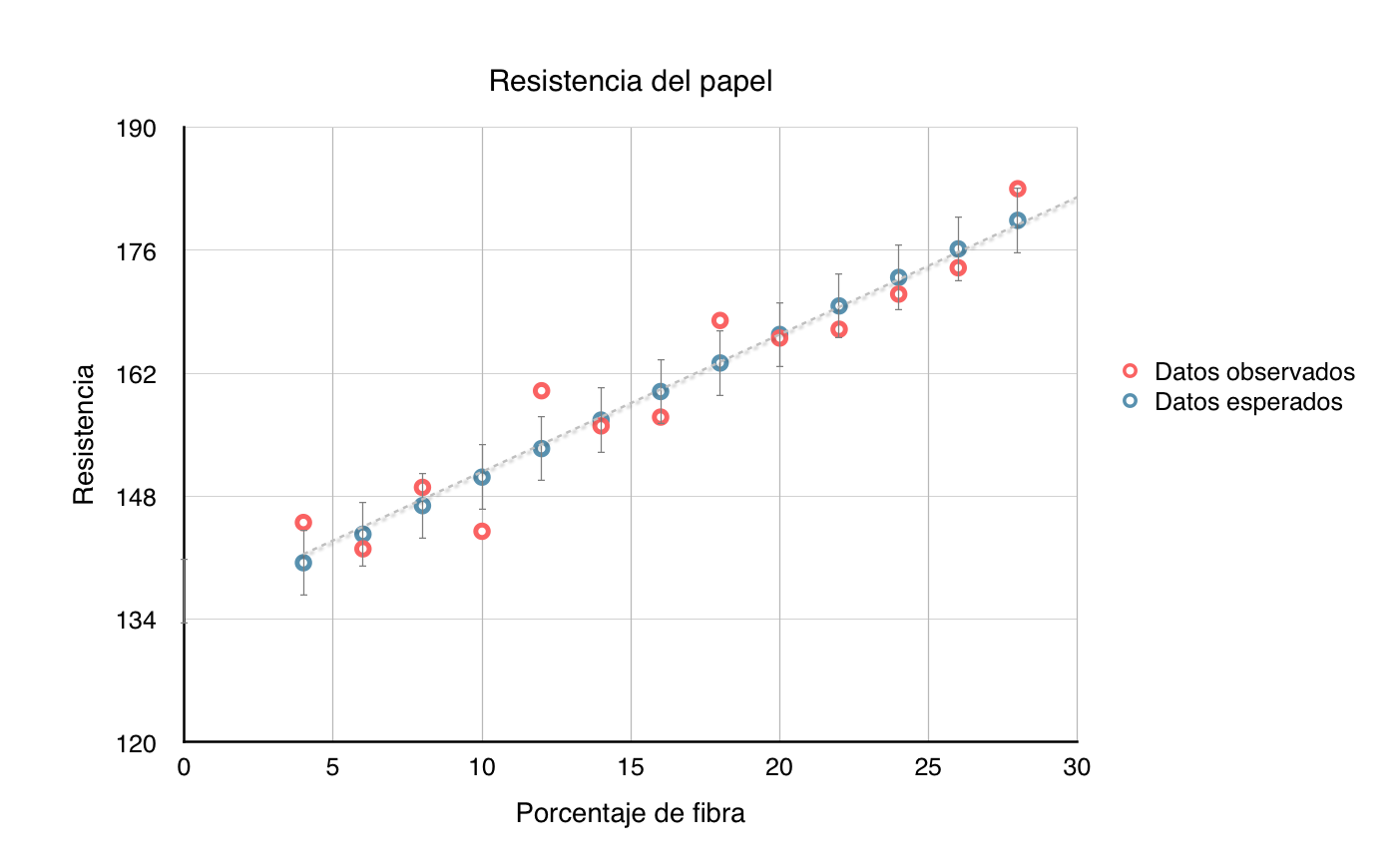

Del ejercicio del tema anterior, dedujimos, por mínimos cuadrados, la ecuación de esta recta del modelo lineal

$$\hat y = 1.62 (x) + 130.67 $$

Y el error estándar de la estimación:

$$S_{xy}=\sqrt{\frac{180.93}{13}} = 3.72$$ unidades de resistencia

También afirmamos que Sxy es una medida que resume la diferencia entre lo observado y lo estimado y que este valor Sxy resultaba útil para ver la variabilidad de los datos estimados. Utilizamos este dato para sumar y restar a los datos esperados y así ver esta variabilidad gráficamente:

Sin embargo Sxy solo explicaba una parte de la variabilidad.

Ahora, encontraremos un parámetro que explique la mayor parte de la variabilidad.

Primero, agregaremos a la tabla del ejercicio anterior algunas columnas:

| x | y | $$\bar y$$ | $$y-\bar y$$ | $$(y-\bar y)^2$$ | $$\hat y$$ | $$\hat y-\bar y$$ | $$(\hat y-\bar y)^2$$ | $$y-\hat y$$ | $$(y-\hat y)^2$$ |

| 4 | 134 | 158.29 | -24.29 | 589.80 | 137.17 | -21.11 | 445.81 | -3.17 | 10.06 |

| 6 | 145 | 158.29 | -13.29 | 176.51 | 140.42 | -17.87 | 319.19 | 4.58 | 20.98 |

| 8 | 142 | 158.29 | -16.29 | 265.22 | 143.67 | -14.62 | 213.67 | -1.67 | 2.78 |

| 10 | 149 | 158.29 | -9.29 | 86.22 | 146.92 | -11.37 | 129.26 | 2.08 | 4.34 |

| 12 | 144 | 158.29 | -14.29 | 204.08 | 150.16 | -8.12 | 65.95 | -6.16 | 38.01 |

| 14 | 160 | 158.29 | 1.71 | 2.94 | 153.41 | -4.87 | 23.74 | 6.59 | 43.39 |

| 16 | 156 | 158.29 | -2.29 | 5.22 | 156.66 | -1.62 | 2.64 | -0.66 | 0.44 |

| 18 | 157 | 158.29 | -1.29 | 1.65 | 159.91 | 1.62 | 2.64 | -2.91 | 8.47 |

| 20 | 168 | 158.29 | 9.71 | 94.37 | 163.16 | 4.87 | 23.74 | 4.84 | 23.44 |

| 22 | 166 | 158.29 | 7.71 | 59.51 | 166.41 | 8.12 | 65.95 | -0.41 | 0.17 |

| 24 | 167 | 158.29 | 8.71 | 75.94 | 169.65 | 11.37 | 129.26 | -2.65 | 7.05 |

| 26 | 171 | 158.29 | 12.71 | 161.65 | 172.90 | 14.62 | 213.67 | -1.90 | 3.62 |

| 28 | 174 | 158.29 | 15.71 | 246.94 | 176.15 | 17.87 | 319.19 | -2.15 | 4.63 |

| 30 | 183 | 158.29 | 24.71 | 610.80 | 179.40 | 21.11 | 445.81 | 3.60 | 12.96 |

| SUMA | 2216.00 | 2580.86 | 2400.53 | 180.33 |

donde

-

-

- $$\bar y$$ es el promedio de las observaciones de y,

- $$y-\bar y$$ es la diferencia de cada observación con respecto a la media de los valores y

- $$(y-\bar y)^2$$ son los cuadrados de la diferencia anterior

- $$\hat y$$ es el valor estimado mediante la recta de mínimos cuadrados

- $$\hat y-\bar y$$ es la diferencia de cada valor estimado con respecto a la media de los valores y

- $$(\hat y-\bar y)^2$$ son los cuadrados de la diferencia anterior

- $$y-\hat y$$ es la diferencia de los valores observados y esperados

- $$(y-\hat y)^2$$ son los cuadrados de la diferencia anterior

-

El cambio de la variable y depende de muchos factores. El modelo lineal simple permite identificar normalmente uno de ellos. En este caso, la resistencia del papel depende del porcentaje de fibra del mismo. Pero seguramente hay otros factores, como la forma de fabricación, quizá el porcentaje de agua o algún otro factor que no conocemos.

El coeficiente de determinación mide la cantidad relativa de variación que explica la recta de regresión. Esto es, el cambio en y explicado por un cambio en la variable x.

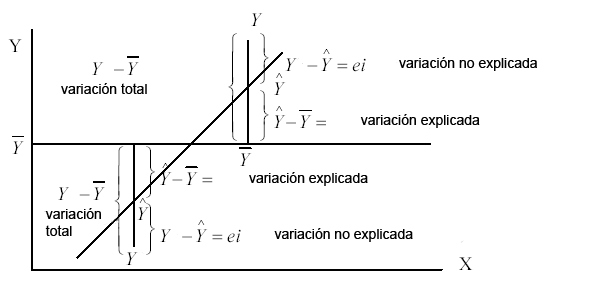

Así, $$y-\bar y$$ mide la variación de y de los datos observados. La diferencia $$\hat y-\bar y$$ es la variación tenida en cuenta por la ecuación de regresión. A esta variación le llamamos variación explicada de y.

$$y-\hat y$$ son variaciones consideradas a factores diferentes al dado por el modelo de regresión, por eso se denomina variación no explicada de y.

La sumatoria de las diferencias en cada una de las formas de variación se representa como:

$$(y-\bar y)^2$$ = variación total

$$(y-\hat y)^2$$ = variación no explicada

$$(\hat y-\bar y)^2$$ = variación explicada

$$\sum (y-\bar y)^2 = \sum (y-\hat y)^2 + \sum (\hat y-\bar y)^2$$ (esto recuerda el ANOVA, no?)

Gráficamente, esto puede explicarse así:

El coeficiente de determinación, como ya mencionamos, es la proporción de cambio explicado en y, por cambio en x. Es decir, representa la variación explicada de la variación total. Otra forma de representar esta proporción sería:

$$r^2=\frac{\sum(\hat y – \bar y)^2}{\sum (y – \hat y)^2 + \sum (\hat y – \bar y)^2} = \frac {\sum (\hat y – \bar y)^2}{\sum (y – \bar y)^2}$$

En otras palabras, el coeficiente de determinación es la relación entre la variación explicada y la variación total. Su valor está entre 0 y 1: $$0< r^2 < 1$$

En este ejemplo

$$r^2 = \frac {2,400.53}{2580.86} = 0.9301\ o \ 93.01%$$

El 93.01% de la variación en la resistencia del papel está explicada por el porcentaje de fibra que contiene.

Si $$r=\sqrt r^2$$ entonces r se denomina coeficiente de correlación y sus valores están entre -1 y +1. En este caso, el signo menos significa una relación negativa y lo contrario una correlación positiva.

$$r =\sqrt { \frac {\sum (\hat y – \bar y)^2}{\sum (y – \bar y)^2}}$$

$$r = \sqrt {\frac {2,400.53}{2580.86}} = \sqrt 0.9301= 0.9644%$$

En este caso el coeficiente r tiene signo positivo ya que la pendiente tiene un valor positivo.

Los valores de r se pueden interpretar de la siguiente forma

| 0.0 | – | 0.2 | correlación muy débil. Despreciable |

| 0.2 | – | 0.4 | correlación débil |

| 0.4 | – | 0.7 | correlación moderada |

| 0.7 | – | 0.9 | correlación fuerte, importante |

| 0.9 | – | 1.0 | correlación muy fuerte. Alta dependencia |

La correlación de dos variables existe. Puede ser o no satisfactoria, pero ello depende de la interpretación de los datos. Pero esto no determina una relación causal. Si las variables x e y están correlacionadas, esto puede ser porque x causa a y, o porque y causa a x; o porque existe otra variable no identificada que causa tanto a x como a y, o por una combinación de todas estas razones. O porque simplemente la relación encontrada se debe al azar.